Forum sur la Sécurité intérieure de la FSFP

L’intelligence artificielle : bénédiction ou risque ?

Lorsqu’il s’agit d’équipements modernes pour la police, le sujet de l’ IA est sur toutes les lèvres. Mais quel est le rôle de l’IA dans les services de police ? Qu’est-ce qui est autorisé ? Et comment les criminels et les terroristes tirent-ils profit de l’IA ? Lors du Forum sur la Sécurité intérieure 2025 organisé par la FSFP à Berne, des experts de renom ont abordé ces questions et bien d’autres encore.

« Sécurité 4.0 - Jusqu’où la police peut-elle aller avec l’IA ? » Tel était le thème du Forum sur la Sécurité intérieure organisé début novembre 2025 à Berne par la Fédération suisse des fonctionnaires de police (FSFP). Un sujet qui suscite beaucoup d’intérêt, comme l’a démontré la salle comble du Casino de Berne.

Le Forum sur la Sécurité intérieure organisé par la FSFP à Berne a une nouvelle fois été très instructif et a attiré les foules.© Jörg Rothweiler

Le Forum sur la Sécurité intérieure organisé par la FSFP à Berne a une nouvelle fois été très instructif et a attiré les foules.© Jörg Rothweiler

L’IA transforme durablement le travail de la police

En ouverture du Forum, Olivier Ribaux, professeur à l’École des sciences criminelles de l’Université de Lausanne, a illustré la rapidité avec laquelle les développements dans le domaine de l’IA progressent et à quel point ceux-ci sollicitent, et parfois dépassent, la politique, les institutions étatiques et la société. « L’IA nous oblige à opérer des changements profonds et les corps de police doivent apprendre à comprendre les développements, les technologies, les possibilités et les menaces », a-t-il expliqué.

Il ne suffit pas de se concentrer uniquement sur ce que l’IA peut apporter à chacun. « Les applications d’IA sont bien sûr précieuses dans de nombreux domaines tels que la rédaction de rapports, la transcription (de la parole à l’écrit, de l’image à l’écrit), la traduction, la reconnaissance biométrique ou le traitement des données. Mais il est tout aussi essentiel de reconnaître que l’IA modifie la nature même de la criminalité », a averti Olivier Ribaux. « Intensifier les efforts actuels ne suffira donc pas. Il faudra plutôt adapter les stratégies et les méthodes de travail existantes. Les forces de police doivent agir différemment, explorer de nouvelles voies, s’adapter aux nouvelles circonstances. »

Outre la nécessité d’intensifier la recherche afin de mieux comprendre l’intégration des différentes formes d’IA dans les structures criminelles, le potentiel de l’IA pour de nouvelles stratégies de réaction et son développement futur, Olivier Ribaux a défini trois priorités pour les corps de police suisses : Expérimenter de manière diversifiée différentes applications d’IA afin d’évaluer leur potentiel et leur utilité. Tirer les bonnes leçons afin de favoriser un développement ciblé. Et adapter les processus de recrutement et de formation. « L’IA nécessite un travail policier différent, et donc des profils de poste différents », explique Olivier Ribaux.

Il est également important de former, d’informer et d’impliquer la population. « L’escroquerie touche actuellement principalement la génération plus âgée, qui n’est pas (encore) très familiarisée avec les méthodes numériques telles que les services bancaires en ligne ou les achats en ligne. Si l’on veut endiguer la criminalité dans ce domaine, l’information est indispensable », a souligné Olivier Ribaux.

L’IA rend la criminalité et le terrorisme plus vifs, plus efficaces et plus malveillants

Le Dr Jean-Marc Rickli, responsable des risques mondiaux et émergents au Centre de politique de sécurité de Genève (GCSP), a montré à quel point les méthodes des criminels avaient déjà changé et continueront de changer grâce à l’IA. Il a commencé par un exemple qui illustre très concrètement les avantages, mais également les risques de l’IA : « En 2013, Google Glass a lancé les premières lunettes avec caméra intégrée et connexion Internet. Le début fut un échec. Jusqu’à ce que Ray-Ban et Meta intègrent l’IA au système. Les possibilités sont certes fascinantes. Mais les défenseurs de la protection des données et les experts en sécurité s’inquiètent. En effet, grâce à ces lunettes équipées d’une caméra et de l’IA, les criminels peuvent découvrir en quelques secondes tout ce qu’il y a à savoir sur une personne qui leur était auparavant totalement inconnue. Tous les mécanismes de protection que nous connaissions jusqu’à présent disparaissent d’un seul coup. Il en résulte une profonde incertitude, tant chez la population que dans les corps de police. »

D’autres exemples cités par Jean-Marc Rickli ont également suscité des réactions lors du Forum. Ainsi, l’individu qui a fait exploser une Tesla Cybertruck devant la Trump Tower à Las Vegas le matin du Nouvel An 2025 a utilisé une solution d’IA pour calculer la quantité d’explosifs nécessaire. D’autres criminels utilisent les photos et vidéos publiées par des parents naïfs sur les réseaux sociaux pour « intégrer » leurs enfants dans des contenus pédopornographiques. Ou pour passer des appels téléphoniques choquants, au cours desquels les victimes sont confrontées à des voix générées par l’IA de leurs propres enfants ou proches afin de leur soutirer de l’argent. « L’une des principales applications permettant de créer des deepfakes a déjà été téléchargée 134 millions de fois, et même son fabricant ignore qui l’utilise », explique Jean-Marc Rickli.

Bien entendu, les terroristes utilisent également depuis longtemps les outils d’IA. Les vidéos deepfake servent à la radicalisation et à l’enrôlement, les incels sont recrutés à l’aide de contenus générés par l’IA et des drones équipés de la reconnaissance faciale par IA sont utilisés pour des assassinats ciblés. Deep Robotics de Lynx permet en outre de développer des robots toujours plus performants. « Aux États-Unis, vous pouvez acheter sur www.throwflame.com pour 9 420 dollars américains le < Thermonator >, un chien robot doté d’une vision laser et d’un lance-flammes d’une portée de près de 30 mètres. Imaginez que vous vous retrouviez soudainement face à un tel robot lors d’une perquisition dans votre couloir », a averti Jean-Marc Rickli.

Selon lui, tout cela n’est qu’un début. « Les possibilités de l’IA croissent de manière exponentielle. Les systèmes d’intelligence collective pour les drones et les armes sont développés de manière totalement incontrôlée. Les systèmes d’IA, initialement développés pour la recherche de substances pharmaceutiques actives, peuvent être reprogrammés pour concevoir des toxines mortelles ou des agents pathogènes. Dans le cadre d’une expérience, une telle IA a trouvé en seulement une heure quatre virus pouvant être utilisés pour créer une pandémie artificielle. Une autre a calculé en six heures 40 000 armes chimiques potentielles. Les solutions d’IA générative permettent également de créer de tout nouveaux types de logiciels malveillants. Et la dernière étape de l’évolution, l’« IA agentique », ne se contente plus de guider l’homme. Elle comprend les questions, analyse les solutions possibles, développe ses propres stratégies et les met en œuvre. À cela s’ajoutent les interfaces humain-machine. Celles-ci peuvent être une bénédiction pour les personnes en situation de handicap. Mais entre de mauvaises mains, elles deviennent un risque incalculable. »

D’une manière générale, selon Jean-Marc Rickli, les technologies d’IA ont tendance à devenir des acteurs indépendants, qui continuent à se développer et poursuivent leurs propres stratégies. « Les fabricants ont depuis longtemps perdu le contrôle de l’utilisation de leurs produits, s’ils l’ont jamais eu. La technologie devient de plus en plus autonome, elle évolue rapidement et parfois de manière incontrôlée. Initialement conçue pour renforcer la sécurité, l’IA accentue les dangers existants et génère parfois des risques totalement nouveaux. Autre fait : l’IA promet des profits considérables, et la Chine et les États-Unis se disputent avec véhémence la suprématie dans ce domaine. Les valeurs telles que l’éthique, la sécurité ou l’humanité ne jouent plus aucun rôle depuis longtemps, et la législation est nettement à la traîne par rapport à cette évolution. »

Emmanuel Fivaz, président de la FSFP, a accueilli les participants au Forum par vidéo. « Grâce à l’IA, je parle parfaitement l’allemand et l’italien », a-t-il déclaré en souriant.© Jörg Rothweiler

Emmanuel Fivaz, président de la FSFP, a accueilli les participants au Forum par vidéo. « Grâce à l’IA, je parle parfaitement l’allemand et l’italien », a-t-il déclaré en souriant.© Jörg Rothweiler

Des garde-fous juridiques sont indispensables pour l’IA

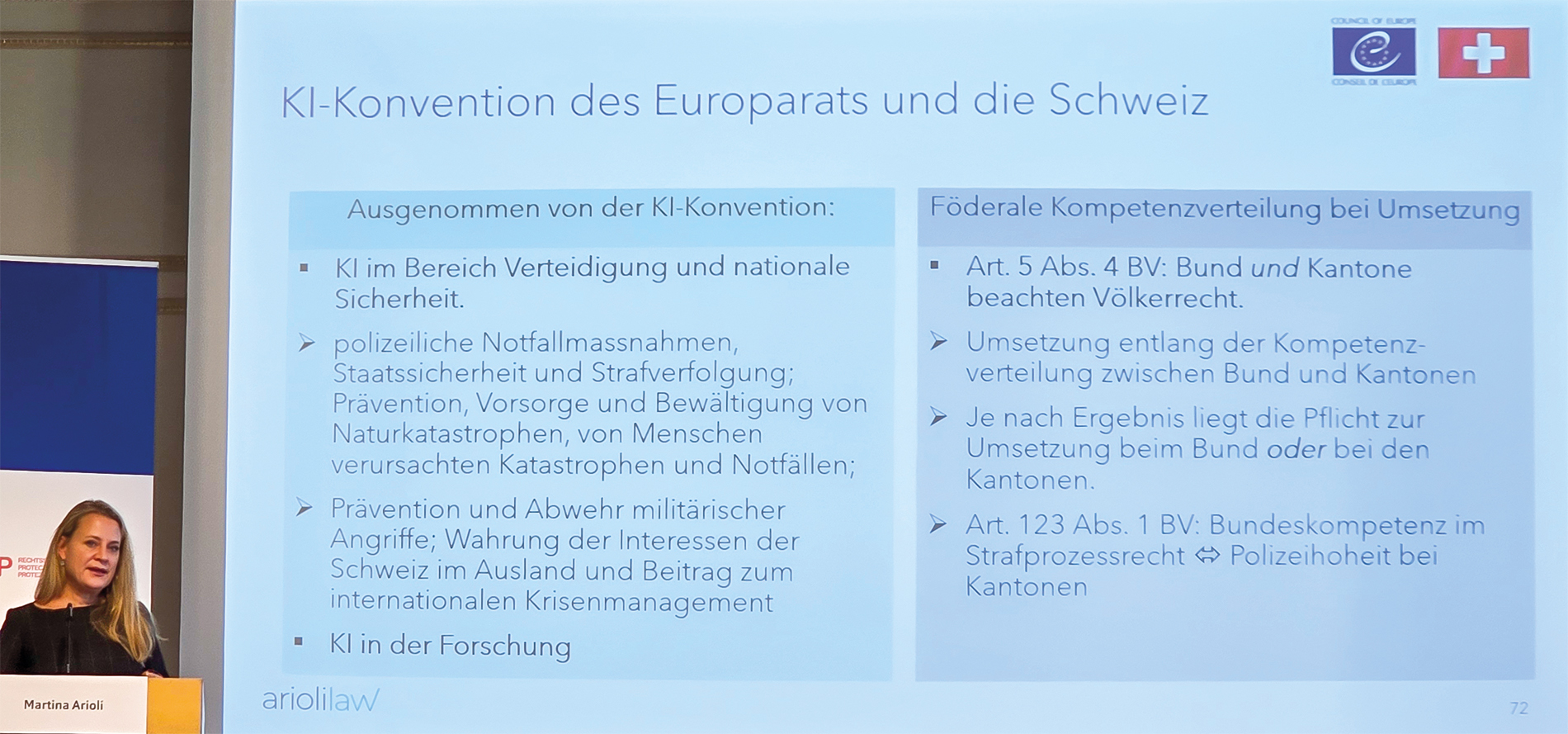

Cela vaut également pour la Suisse, comme l’a souligné Martina Arioli, avocate à Zurich. « La situation juridique est tout sauf claire. Il existe une grande incertitude juridique tant concernant la prévention des abus ou de l’utilisation criminelle de l’IA que la question de savoir si, dans quel but, dans quelles conditions et dans quel cadre juridique les forces de police sont autorisées à utiliser des outils d’IA », a déploré Martina Arioli. La Suisse ratifiera certes la convention du Conseil de l’Europe sur l’IA, qui concerne principalement le droit international, et la transposera dans le droit suisse de manière sectorielle. Mais l’« EU AI Act », c’est-à-dire le règlement directement applicable envisagé pour tous les États membres, ne sera pas adopté.

« La Confédération ne dispose actuellement pas de la compétence pour réglementer directement l’utilisation de l’IA au niveau cantonal, par exemple dans les corps de police. Cela entraîne des incertitudes juridiques au niveau cantonal. En effet, comment les cantons peuvent-ils réglementer de manière autonome l’utilisation de l’IA sans savoir jusqu’où iront les révisions au niveau fédéral ? », a déclaré l’avocate. La décision du 17 octobre 2024 relative à la loi sur la police lucernoise a notamment clairement montré que les mesures de surveillance basées sur l’IA, telles que la recherche automatisée de véhicules et la reconnaissance faciale, ne sont autorisées que si elles reposent sur une base légale suffisamment précise. Cela signifie que les cantons doivent établir des réglementations précises concernant l’affectation, les délais de conservation et les mécanismes de contrôle, et concevoir l’utilisation de l’IA de manière différenciée, transparente et conforme aux droits fondamentaux. Mais on peut se demander comment les cantons peuvent créer les bases nécessaires à cet effet si aucun cadre reconnu à l’échelle nationale n’est défini.

Sans entrer dans les détails juridiques, une chose est sûre : les technologies d’IA se développent à la vitesse de la lumière et les criminels et terroristes exploitent de plus en plus leurs capacités. Face à eux, les autorités judiciaires doivent respecter des bases légales claires pour toute utilisation de l’IA à des fins de prévention des menaces à l’État de droit, bases qui sont encore largement inexistantes à ce jour. Cette situation est effrayante et ne contribuera certainement pas à transformer la profonde incertitude que ressent déjà aujourd’hui une grande partie de la population à l’égard de l’IA en une confiance solide dans l’État et ses institutions.

L’avocate Martina Arioli a souligné la complexité de la situation juridique actuelle concernant l’utilisation de l’IA par les forces de police suisses.© Jörg Rothweiler

L’avocate Martina Arioli a souligné la complexité de la situation juridique actuelle concernant l’utilisation de l’IA par les forces de police suisses.© Jörg Rothweiler

L’Office fédéral allemand de la police criminelle utilise déjà l’IA, avec succès

Un coup d’œil au-delà de la frontière nord montre toutefois qu’il existe d’autres approches. En effet, l’IA est déjà largement utilisée à l’Office fédéral allemand de la police criminelle (BKA), comme le rapporte son président Holger Münch : « Depuis notre première utilisation d’outils d’IA dans le cadre de l’enquête sur le scandale financier des < Panama Papers >, nous n’avons cessé de développer nos compétences en matière d’IA. Actuellement, nous avons 65 systèmes d’IA en service, 15 en cours de développement et 25 autres en phase d’analyse des besoins dans notre laboratoire d’IA. À ce jour, plus de 7 000 procédures pénales ont permis de saisir d’énormes quantités d’argent et plus de 50 tonnes de stupéfiants. Et plus de 10 000 années de prison ont été prononcées au total. Nos établissements pénitentiaires sont saturés en raison de l’IA. »

Concrètement, le BKA utilise un chatbot IA pour les demandes, divers outils de transcription et de traduction, ainsi que des solutions d’analyse d’images et de vidéos, y compris la reconnaissance faciale par l’IA. Grâce à l’interaction de ces systèmes, les agents du BKA peuvent non seulement découvrir l’appartenance de certains criminels à des groupes, mais également identifier des structures de gangs complexes et des liens institutionnels. « Bien entendu, cela nécessite également une formation intensive des employés et des changements dans les ressources humaines », a souligné Holger Münch. « Nos experts en photographie

deviennent des gestionnaires de processus d’IA, nous ne formons plus d’employés de bureau et observons de manière générale une évolution marquée des profils requis. Nous nous éloignons du généraliste pour nous diriger vers le spécialiste. »

Les investissements technologiques ne doivent pas non plus être sous-estimés, selon Holger Münch. « Notre système d’IA se développe et nécessite de plus en plus d’électricité et de puissance de calcul. C’est pourquoi nous souhaitons mettre en place une architecture multi-cloud dans une prochaine étape. À cela s’ajoutent des défis en matière de gestion des données, de conformité et de mise en œuvre de cas d’utilisation concrets dans des applications d’IA exploitables, pour lesquels nous employons du personnel hautement qualifié. »

Son conseil aux forces de police suisses est le suivant : « Faites preuve de courage, commencez par ce que vous êtes autorisés à faire. Examinez, réfléchissez et discutez des possibilités, et assurez-vous de disposer des ressources financières nécessaires pour la technologie, la formation et le développement. Vous devez également formuler des exigences claires quant à ce que vous souhaitez accomplir précisément avec l’IA. La surveillance en direct avec la reconnaissance faciale par l’IA est un scénario très différent de la recherche de personnes dans des images obtenues légalement afin d’identifier des auteurs d’infractions ou de découvrir d’éventuels liens entre des membres de bandes criminelles. Plus les scénarios d’utilisation de l’IA sont définis de manière concrète, plus les bases juridiques nécessaires peuvent être définies avec précision. »

L’IA offre des opportunités pour le travail de la police, et la Suisse doit s’y atteler

Holger Münch a reçu l’approbation de Matteo Cocchi, président de la Conférence des commandants des polices cantonales de Suisse (CCPCS) et commandant de la police cantonale du Tessin. Celui-ci a déclaré : « Les outils d’IA tels que l’analyse prédictive de la criminalité, les systèmes de surveillance automatisés, les aides à la traduction et à la transcription ainsi que les aides électroniques à l’enquête améliorent l’efficacité et la précision du travail d’enquête et de prévention. Mais chaque application d’IA doit être supervisée par un être humain. C’est la seule façon de gagner la confiance essentielle de la population. »

Matteo Cocchi identifie deux défis à relever : la création d’une base juridique uniforme pour l’utilisation de l’IA par la police et la mise en place de mesures d’accompagnement pour l’échange et la collecte de données. « Actuellement, j’obtiens plus rapidement et plus facilement des données provenant d’Allemagne que de Zurich, de Genève ou des Grisons. Cela doit changer. De plus, nous devons bien sûr veiller à ce que toutes les données analysées par l’IA soient sûres et fiables. »

Malgré toutes les incertitudes existantes, Matteo Cocchi demande à la Suisse de mettre un coup d’accélérateur. « Nous devons nous lancer, même au risque que le législateur nous rappelle à l’ordre sur l’une ou l’autre idée. Car celui qui ne se lance jamais n’arrivera jamais à destination », a-t-il averti.

Les drones de combat dotés d’une intelligence collective grâce à l’IA ne sont plus une utopie depuis longtemps, et sont également accessibles aux terroristes.© shutterstock.com

Les drones de combat dotés d’une intelligence collective grâce à l’IA ne sont plus une utopie depuis longtemps, et sont également accessibles aux terroristes.© shutterstock.com

La formation initiale et continue est indispensable

Stefan Aegerter, qui a terminé le jour du Forum son dernier jour en tant que directeur de l’Institut suisse de police (ISP), estime que des jalons importants ont déjà été posés dans la formation policière : « Le concept global de politique de formation (CPF) tient déjà compte de diverses compétences d’avenir liées à l’IA. Les forces de police s’entraînent dans des environnements d’IA et nous savons que, utilisée à bon escient, l’IA augmente l’effet d’apprentissage et optimise les ressources. »

Comme l’a déjà mentionné Matteo Cocchi, l’être humain doit rester un pilier important. « L’intuition, l’expérience et l’éthique ne peuvent être remplacées par aucun algorithme. L’IA doit faciliter l’apprentissage et le travail de la police, et non remplacer l’être humain », a souligné Stefan Aegerter. Il est en outre essentiel d’établir un équilibre juridiquement sûr entre la technologie et le contrôle. Les futures forces d’intervention doivent être sensibilisées à l’utilisation responsable des données, à la transparence et à la proportionnalité.

« L’absence actuelle de bases juridiques uniformes, sans va-et-vient fastidieux entre la Confédération et les cantons, constitue un obstacle majeur », a déclaré Stefan Aegerter. « Nous avons besoin de forces de police souveraines qui utilisent l’IA de manière responsable et correcte, sur la base de normes nationales et de procédures clairement définies. »

Il y a beaucoup à faire, et le gouvernement fédéral doit agir

À l’issue d’un forum passionnant, une chose est claire : la police suisse ne peut échapper à l’IA. Les points d’action centraux sont les investissements dans le développement et l’exploitation de solutions d’IA performantes, la formation initiale et continue adéquate des forces de police, ainsi que l’évolution ciblée du profil d’exigences, jusqu’à présent fortement axé sur le généraliste, des « travailleurs sociaux en uniforme portant une arme de service », comme le président de la BKA appelle les forces de police avec un clin d’œil. La politique et la législation doivent en outre se montrer à la hauteur. Un cadre juridique pour l’IA est indispensable, et la Confédération ne doit pas laisser les cantons seuls face à cette question. En effet, la stratégie régulièrement mise en avant par le Conseil fédéral dans les situations complexes, qui consiste à « observer les développements », échouera immanquablement dans le domaine de l’IA.